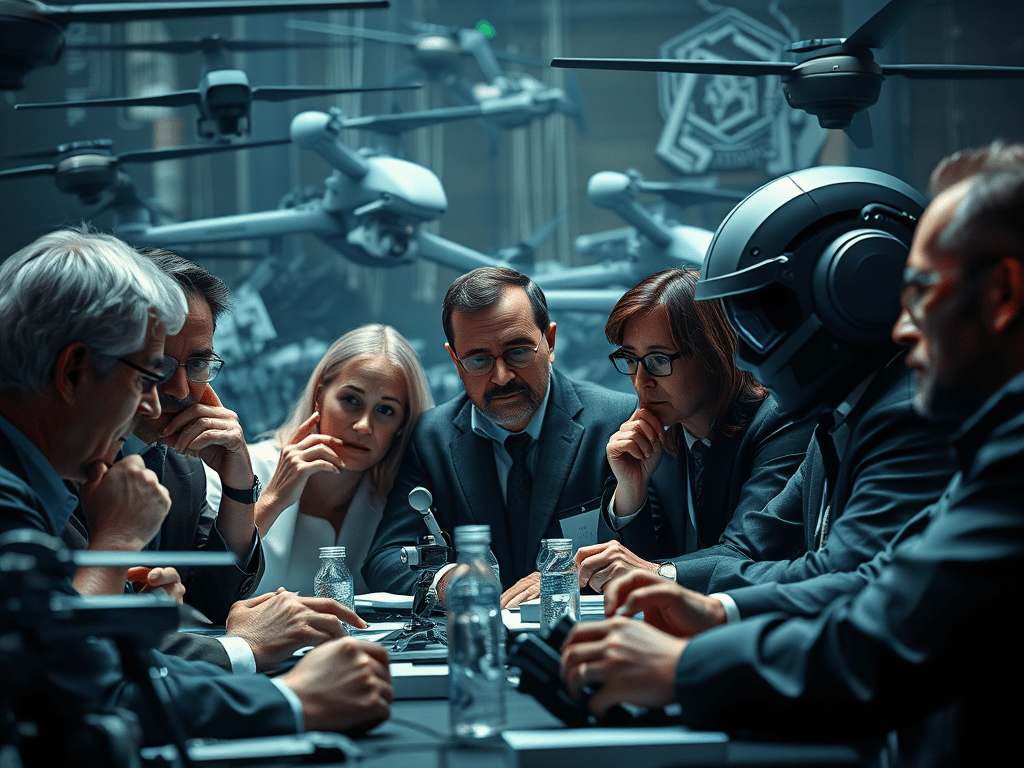

වේගවත් තාක්ෂණික දියුණුව හේතුවෙන්, යුද කටයුතු සඳහා කෘතිම බුද්ධිය භාවිතය සහ ප්රසම්පාදනය (මිලදී ගැනීම) නියාමනය කිරීම පිළිබඳ හදිසි සාකච්ඡා මතු වී ඇත.

එක්සත් ජනපදය, ඊශ්රායලය සහ ඉරානය අතර උත්සන්න වෙමින් පවතින ගැටුම් මගින් යුද කටයුතු සඳහා කෘතිම බුද්ධිය (AI) භාවිතා කිරීම පිළිබඳ දැඩි අවධානයක් යොමු වී ඇත. පෙබරවාරි 28 වන දින එක්සත් ජනපද-ඊශ්රායල ප්රහාර ආරම්භ වීමට දිනකට පෙර, එක්සත් ජනපද රජය තම ප්රධාන AI සැපයුම්කරුවෙකු පසෙකට දැමීමට කටයුතු කළේය. ඒ AI භාවිතයේ සදාචාරාත්මක ගැටලු සම්බන්ධයෙන් ඇති වූ එකඟ නොවීම් හේතුවෙනි.

මේ සතියේ, ස්විට්සර්ලන්තයේ ජිනීවා නුවරදී විද්වතුන් සහ නීති විශාරදයින් මාරාන්තික ස්වයංක්රීය අවි පද්ධති සහ මිලිටරි අංශයේ AI භාවිතය පිළිබඳව සාකච්ඡා කිරීමට රැස්ව සිටිති. මෙය යුධ සමයක AI භාවිතයේ සදාචාරාත්මක සහ නීතිමය සීමාවන් පිළිබඳ ජාත්යන්තර එකඟතාවයකට පැමිණීම සඳහා කාලයක සිට ගන්නා උත්සාහයක කොටසකි.

පෙන්සිල්වේනියා විශ්වවිද්යාලයේ දේශපාලන විද්යාඥ මයිකල් හොරොවිට්ස් (Michael Horowitz) පවසන්නේ, “වේගවත් තාක්ෂණික දියුණුව හමුවේ ජාත්යන්තර සාකච්ඡා ඉතා මන්දගාමී වී ඇති” බවයි.

උදාහරණයක් ලෙස Maven Smart System යනු ඇමරිකානු ආරක්ෂක දෙපාර්තමේන්තුව විසින් දියත් කරන ලද, යුධ කටයුතු සඳහා කෘතිම බුද්ධිය (AI) භාවිතා කරන ඉතා සංකීර්ණ තාක්ෂණික ව්යාපෘතියකි.

මෙම පද්ධතිය ක්රියා කරන ආකාරය සරල පියවර කිහිපයකින් පහත පරිදි පැහැදිලි කළ හැකිය:

- දත්ත රැස්කිරීම (Data Collection)

යුධ පිටියේ සැරිසරන ඩ්රෝන යානා (Drones), චන්ද්රිකා (Satellites) සහ අනෙකුත් සංවේදක මගින් දිනපතා අතිවිශාල වීඩියෝ දර්ශන සහ ඡායාරූප ප්රමාණයක් ලබා ගනී. මිනිස් බුද්ධි අංශ නිලධාරීන්ට මේ සියලු දත්ත එකින් එක පරීක්ෂා කිරීම ප්රායෝගිකව ඉතා අපහසු සහ කාලය වැය වන කාර්යයකි. - පරිගණක දෘෂ්ඨිය (Computer Vision) භාවිතය

Maven පද්ධතියේ හදවත වන්නේ Computer Vision නැමැති AI තාක්ෂණයයි. මෙහිදී “ගැඹුරු ඉගෙනුම” (Deep Learning) මගින් පරිගණක ඇල්ගොරිතම පුහුණු කරනු ලබන්නේ රූප රාමු තුළ ඇති වස්තූන් හඳුනා ගැනීමටයි.

උදාහරණයක් ලෙස: වීඩියෝවක පෙනෙන්නේ සාමාන්ය මෝටර් රථයක්ද, නැතිනම් යුද ටැංකියක්ද? පෙනෙන්නේ සාමාන්ය ගොවියෙක්ද, නැතිනම් අවි ගත් සෙබළෙක්ද? යන්න හඳුනා ගැනීමට පද්ධතියට හැකිය.

- වස්තු හඳුනාගැනීම සහ වර්ගීකරණය (Detection & Classification)

පද්ධතිය මගින් රූප රාමුවල ඇති වස්තූන් ස්වයංක්රීයව ලේබල් කරනු ලබයි:

මිනිසුන්: පුද්ගලයන් කී දෙනෙක් සිටිනවාද?

වාහන: ඒවා කුමන වර්ගයේ ඒවාද? (Trucks, Cars, Tanks)

ගොඩනැගිලි: ඒවායේ ස්වභාවය කුමක්ද?

- බුද්ධි තොරතුරු විශ්ලේෂණය (Intelligence Analysis)

හුදෙක් රූප හඳුනා ගැනීමට අමතරව, එම වස්තූන්ගේ හැසිරීම් රටාවන් විශ්ලේෂණය කිරීමටද මෙයට හැකිය. උදාහරණයක් ලෙස, යම් වාහනයක් සැකකටයුතු ස්ථානයක නිතර ගැවසෙන්නේ නම්, පද්ධතිය ඒ පිළිබඳව නිලධාරීන්ට අනතුරු ඇඟවීම් නිකුත් කරයි. - ඉලක්ක ලබා දීම සහ තීරණ ගැනීම (Targeting Support)

මෙහි ඇති වැදගත්ම (සහ මතභේදාත්මකම) කාර්යය වන්නේ ප්රහාර එල්ල කළ යුතු ඉලක්ක යෝජනා කිරීමයි. Maven පද්ධතිය මගින් සතුරු ඉලක්ක විය හැකි ස්ථාන ප්රමුඛතාගත කර හමුදා නිලධාරීන් වෙත ඉදිරිපත් කරයි. මෙය යුධ පිටියේදී තීරණ ගන්නා වේගය (Speed of Decision-making) බෙහෙවින් වැඩි කරයි.

Maven Smart System යනු “මිනිස් ඇසට කළ නොහැකි වේගයකින් බුද්ධි තොරතුරු පෙරීම” සිදු කරන පද්ධතියකි. මෙය ක්රියා කරන්නේ හමුදා විශ්ලේෂකයෙකුට සහාය දෙන “සහයකයෙකු” ලෙසයි.

වැදගත් කරුණක්: වර්තමානය වන විටත් මෙම පද්ධතියේ අවසාන ප්රහාරක තීරණය ගනු ලබන්නේ මිනිසෙකු විසිනි (Human-in-the-loop). එනම්, AI මගින් ඉලක්කයක් යෝජනා කළත්, එයට වෙඩි තැබීමට අණ ලබා දෙන්නේ මිනිස් නිලධාරියෙකි.

මෙම පද්ධතිය නිසා සිවිල් වැසියන්ට වන හානිය අඩු වන බවට ඇමරිකානු හමුදාව තර්ක කළත්, AI තාක්ෂණය වැරදි ලෙස ඉලක්ක හඳුනා ගැනීමේ අවදානමක් පවතින බව විද්යාඥයන් පෙන්වා දෙයි.

යුද පිටියේ කෘතිම බුද්ධිය

එක්සත් ජනපද හමුදාව සැපයුම් කටයුතු (Logistics), බුද්ධි තොරතුරු රැස් කිරීම සහ යුද පිටියේ තීරණ ගැනීම සඳහා විශාල භාෂා ආකෘති (LLMs) මත පදනම් වූ AI භාවිතා කරන බව හොරොවිට්ස් පවසයි. උදාහරණයක් ලෙස, Maven Smart System පද්ධතිය ඉලක්ක හඳුනා ගැනීම සහ ඒවා ප්රමුඛතා ගත කිරීම මගින් ප්රහාරක හැකියාවන් වේගවත් කරයි. වොෂින්ටන් පෝස්ට් පුවත්පතට අනුව, මෙම පද්ධතිය ඉරානයට එල්ල කළ ප්රහාර සඳහා ද භාවිතා කර ඇත.

කෘතිම බුද්ධියේ නිරවද්යතාවය නිසා සිවිල් වැසියන්ට සිදුවන හානිය අවම කර ගැනීමට උපකාරී වනු ඇතැයි ඇතැමුන් තර්ක කළද, යථාර්ථය වෙනස් විය හැකිය.

යුක්රේනය සහ ගාසා: මෙම ගැටුම්වලදී AI භාවිතා කළද සිවිල් මරණ සංඛ්යාව ඉතා ඉහළ මට්ටමක පවතී.

නිරීක්ෂණය: AI මගින් සිවිල් මරණ අඩු වන බවට කිසිදු සාක්ෂියක් නොමැති බව නිව්කාසල් විශ්වවිද්යාලයේ ක්රේග් ජෝන්ස් පවසයි.

ස්වයංක්රීය අවි: මිනිස් අධීක්ෂණයකින් තොරව ක්රියා කරන මාරාන්තික ස්වයංක්රීය අවි (Lethal Autonomous Weapons) භාවිතය දැඩි මතභේදයට තුඩු දී ඇත.

ගැඹුරු අවධානයට ලක් වූ මතභේද

එක්සත් ජනපද ආරක්ෂක දෙපාර්තමේන්තුව සහ කැලිෆෝනියාවේ Anthropic සමාගම අතර ඇති වූ මතභේදයට හේතුව AI හි අනාගත භාවිතයන්ය. Anthropic සමාගම තම ‘Claude’ නැමැති AI ආකෘතිය සමූහ නිරීක්ෂණ කටයුතු සඳහා හෝ මිනිස් අධීක්ෂණයකින් තොර ස්වයංක්රීය අවි පාලනය සඳහා භාවිතා කිරීමට ඉඩ දීම ප්රතික්ෂේප කළේය.

මෙහි ප්රතිඵලයක් ලෙස, පෙබරවාරි 27 වන දින එක්සත් ජනපද ජනාධිපති ඩොනල්ඩ් ට්රම්ප් Anthropic තාක්ෂණය භාවිතා කිරීම නතර කරන ලෙස රජයට නියෝග කළේය. ඉන් අනතුරුව රජය OpenAI සමාගම සමඟ ගිවිසුමකට එළඹ ඇත. කෙසේ වෙතත්, ගූගල් (Google) සහ OpenAI හි සේවකයින් පවා තම තාක්ෂණය මිනිසුන් මැරීම සඳහා යොදා ගැනීමට එරෙහිව පෙත්සම් ඉදිරිපත් කරමින් සිටිති.

නීතිමය විසඳුම් සෙවීම

යුද කටයුතුවලදී AI භාවිතය සම්බන්ධයෙන් ජාත්යන්තර එකඟතාවයකට පැමිණීමට ගන්නා උත්සාහයන්ට එක්සත් ජනපදය, ඊශ්රායලය සහ චීනය වැනි රටවලින් නිසි සහයෝගයක් නොලැබෙන බව විචාරකයෝ පවසති.

ස්ටැන්ෆර්ඩ් විශ්වවිද්යාලයේ සයිබර් ආරක්ෂණ විශේෂඥ හර්බට් ලින් පවසන්නේ, AI පද්ධති පරිගණක පද්ධති සමඟ බද්ධ වී ඇති බැවින්, “සම්පූර්ණ ස්වයංක්රීය මාරාන්තික පද්ධතියක්” යන්න නිවැරදිව අර්ථ දැක්වීම පවා අතිශය සංකීර්ණ සහ අපහසු කාර්යයක් වී ඇති බවයි.

නේචර් සඟරාවට නිකොලා ජෝන්ස් (Nicola Jones) සම්පාදනය කළ ලිපියක් ඇසුරෙනි

ප්රතිචාරයක් ලබාදෙන්න